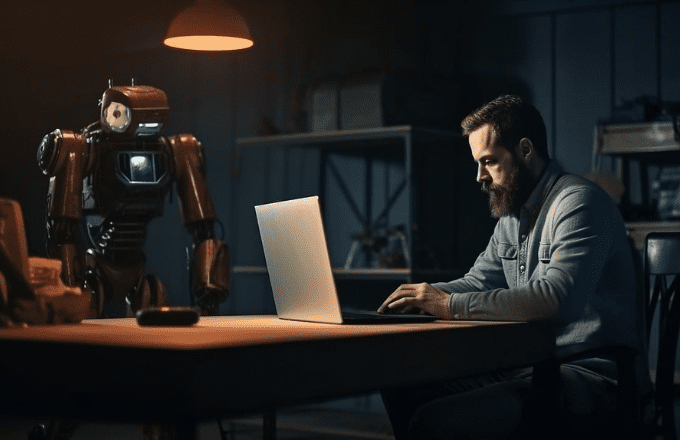

Durante la campaña del presidente, Rodrigo Chaves, se utilizó un bot para que los votantes creyeran que interactuaban con el ahora mandatario, según dio a conocer el Centro Latinoamericano de Investigación Periodística.

El Centro Latinoamericano de Investigación Periodística (CLIP) dio a conocer que, durante la campaña electoral del Partido Progreso Social Democrático (PPSD), se hizo a creer a miles de votantes que interactuaban con el ahora presidente de la República, Rodrigo Chaves, cuando en realidad se trataba de un bot que respondía de manera personal.

Esto fue confirmado por el asesor presidencial, Federico Cruz, quien hoy es el presidente del nuevo partido Aquí Costa Rica Manda.

Por este servicio, la empresa H Ocho Sociedad Anónima, cuyo apoderado legal es Cruz, cobró 25 millones de colones.

En Noticias Columbia conversamos con el abogado penal y consultor en derecho informático, Julio Córdoba, quien explicó que estas herramientas deben dejar claro que se trata de una interacción con un robot y no con una persona. Además, el abogado añadió que las personas deben tomar precauciones sobre la información que comparten con esta tecnología.

«Todo correcto término de servicios, siempre va a quedar absolutamente claro que la persona está interactuando con una persona o con un robot. Esto es importante por un tema de manejo transparente y ético. El segundo punto, es que la persona tiene que saber exactamente qué información está entregando a este bot y qué tratamiento va a tener. ¿Cómo se logra esto? Con una clara explicación sobre cómo se van a tratar los datos personales. Esto es muy importante porque, al conversar sobre temas ideológicos y de gustos electorales, el consumidor electoral está entregando su patrón mental y conductual a la hora de tomar una decisión», explicó Córdoba.

El experto agregó que al momento de estas interacciones existe el peligro de no saber en qué se utilizarán los datos personales recopilados por la herramienta.

«Acá, cuando hablamos de peligro, sería cuando la persona está interactuando sin una consciencia de qué va a ocurrir con sus datos personales. Lo que la política de datos personales es absolutamente clara que la persona consciente lo autoriza y participa en esto, está disponiendo sus datos. Sin embargo, si no hay una política clara de datos personales y la persona participa, está en un absoluto peligro de no saber qué se va a hacer con esos datos que son de carácter personalísimo y jurídicamente se estaría actuando a contrapelo del ordenamiento jurídico», aseguró Córdoba.

En esta misma línea, el también abogado especialista en Derecho Informático, José Medrano, mencionó que por temas de transparencia, es importante que exista claridad sobre el manejo de los datos.

«Los chatbots o robots en internet tienen que tener una política de privacidad donde se establezcan las reglas de cómo se van a tratar los datos personales. Esto es muy importante para que, en transparencia, el usuario sepa sobre cómo van a utilizarse sus datos, una vez interactúe con este robot», detalló el abogado.

Finalmente, Medrano señaló que, en casos donde se trate de herramientas con fines electorales, debería quedar clara la política de privacidad en el manejo y análisis de los datos recopilados.

«Específicamente, no hay ningún tratamiento ilegal con respecto a utilizar bots de inteligencia artificial o bots de alguna manera inteligentes para interactuar con usuarios. Tomando en cuenta que en temas electorales se van a capturar informaciones que vinculan a un individuo con preferencias, porque de estas pueden salir las dudas de los usuarios, debería estar una adecuada política de privacidad para que se pueda tener una claridad sobre cómo se van a tratar los datos de los usuarios», añadió Medrano.